每天收幾十封電子報,但你真的有在「用」它們嗎?

我訂閱了超過 15 份電子報。

每週打開信箱,心情很矛盾——期待有好東西,但又知道自己八成沒時間好好讀。更實際的問題是:就算當下讀完了,那些觀點和數據過幾天就忘了。等到真的要寫文章或跟人討論,腦袋裡只剩一個模糊的印象,卻想不起來出處在哪。

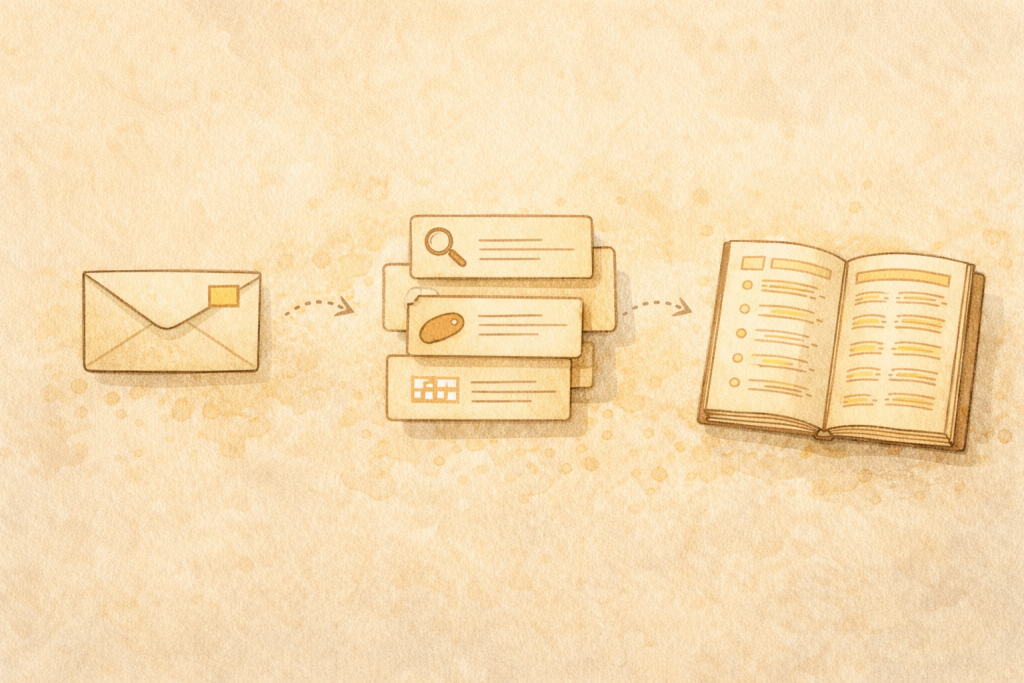

這個狀況持續了很久,後來我用 n8n 搭了一套自動化流程,讓每封電子報讀完之後,精華直接進 Notion,不用我多動一根手指。

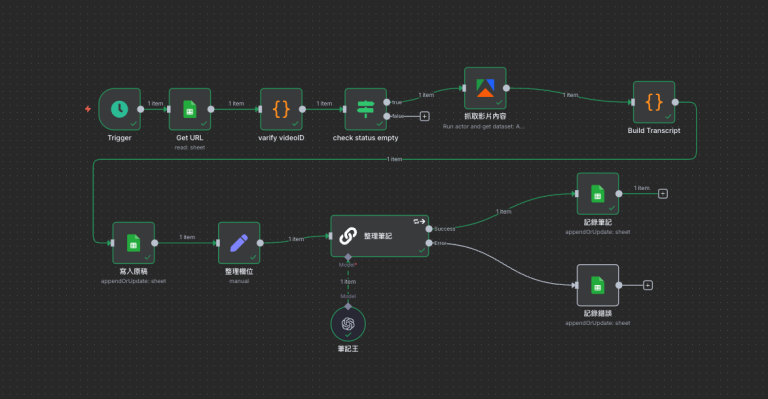

這套流程在做什麼?

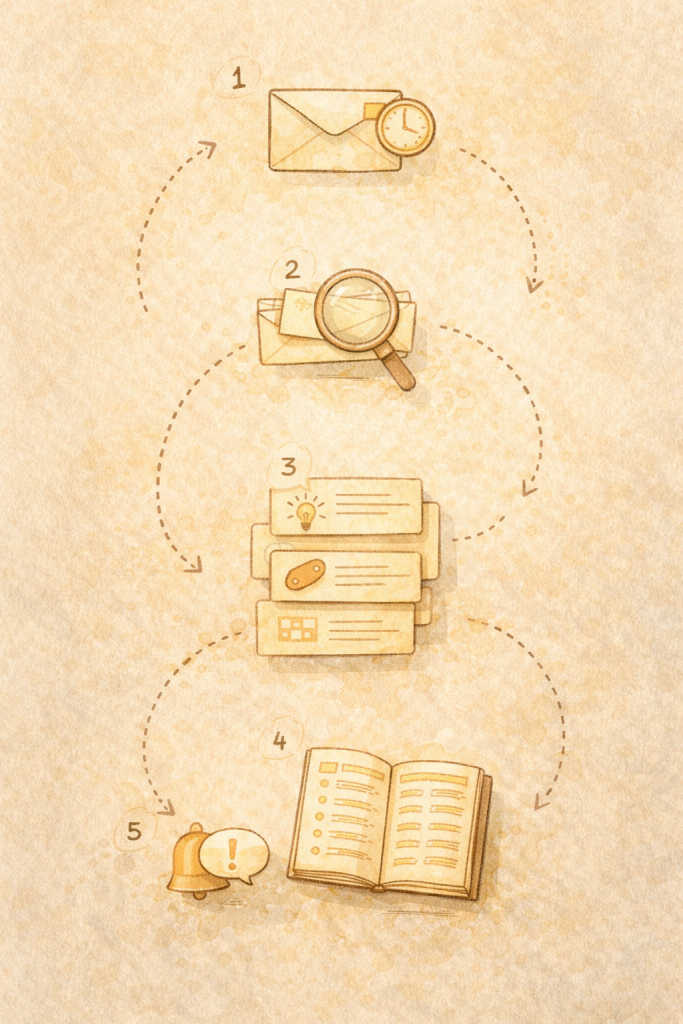

流程分三個階段:

第一階段:認出信件是誰寄的,跳過已處理過的

系統每小時掃一次信箱,看到電子報標籤就開始動作。它內建了 16 個電子報的辨識規則,像是雷蒙三十、狐說八道、Lenny’s Newsletter 這些,能自動判斷這封信來自哪。同時,Google Sheets 會記錄哪些信已經處理過,同一封信不會被跑兩遍。

第二階段:三層 AI 分析

這是整個流程的核心,每封信依序進三個 AI 節點:

知識摘要:整理出這篇最重要的主張是什麼、為什麼值得關注、幾個可以直接引用的金句,還有 2–3 個可以從這篇延伸去寫文章的切入角度。另外還有一個信心分數(0.0–1.0),方便你之後快速判斷哪些值得細看。

內容分類:判斷這篇屬於 AI 科技、經濟、國際情勢還是綜合,評估它有沒有再利用的價值,並給一個建議——是整理成框架卡、列入趨勢追蹤,還是存檔就好。

框架萃取:依內容性質用不同方式拆解。科技類文章會挖它的應用場景、限制邊界、容易踩的坑;財經或國際類文章則著重因果關係、關鍵角色、對立觀點。

第三階段:寫進 Notion,記下狀態

萃取完成,所有欄位寫進 Notion,Google Sheets 狀態同步更新為 done。字數太少的歡迎信、訂閱確認信,系統會自動略過,不浪費 API 費用。

幾個設計上比較值得說的地方

信心分數

AI 給你摘要的同時,也告訴你這份摘要有多可信。廢話多的行銷電子報可能只有 0.2,資料紮實的深度分析可以到 0.9。打開 Notion 的時候,不用全部看一遍,按分數篩就好。

萃取框架會跟著內容變

不是每篇用同一張模板。AI 科技和財經分析需要拆的東西不一樣,系統會自動判斷,輸出對你真正有用的欄位,不是填滿格子就算。

收到不認識的電子報會通知你

如果新訂閱的電子報不在辨識名單裡,Slack 會馬上發一則提醒,讓你去補設定,不會讓它默默溜掉。

出錯也會告訴你哪裡壞了

任何節點出問題,Slack 通知裡會直接寫明是哪個工作流程的哪個節點出錯、原因是什麼,還附執行記錄的連結,不用自己去翻 log 找。

誰可能用得上?幾個實際場景

場景一:內容創作者在找素材

LinkedInThreads部落格

你每週在社群發文,訂了一堆電子報,但讀完就忘,等到要寫的時候腦袋空空。有了這套流程,每封信讀完,Notion 就多一張知識卡,上面已經有三個可以用的寫作角度。要發文前打開 Notion,篩 reuse_potential: high,五分鐘內就能找到本週可以拿來改寫的東西。

場景二:需要持續追蹤某個領域的人

研究者顧問產業分析

你在研究 AI 監管、東南亞市場,或者任何需要長期跟蹤的議題。每篇文章都有 related_topics 和 content_domain 標記,Notion 裡直接 filter「這個月跟 AI 治理有關的內容」。causal_chain 欄位會整理不同電子報對同一趨勢的解讀角度,省掉你自己交叉比對的時間。

場景三:小團隊的知識共享

新創小團隊知識管理

團隊每個人各自訂了不同電子報,但這些東西只存在各自的信箱裡,從來沒有真正流通過。把流程接到公司共用的 Gmail,所有人的電子報精華都進同一個 Notion,新進的人不用花幾個月才能熟悉行業動態,打開資料庫就能看到團隊一點一滴累積的東西。

下一步想做的事

這套流程現在只做到「萃取和儲存」,接下來想延伸的方向:

- 自動產生週報:每週一從 Notion 撈出本週高分條目,直接生成一份摘要寄給自己

- 主題聚合:當多篇電子報都在談同一件事,自動觸發一個彙整節點,做跨來源的綜合分析

- 接向量資料庫:讓 AI 助理可以直接回答「你存的電子報裡,關於 X 說過什麼?」

電子報讀完就算的問題,我自己也卡了很久。這套流程不是什麼魔法,但它確實解決了一件很具體的事:讓我訂閱的東西,至少有機會被用到第二次。

如果你也在解決類似的問題,或者對流程設定有疑問,歡迎留言聊聊。