Shopify AI工程的關鍵不是Copilot

一天花 250 美元 token 成本就會觸發提醒,Shopify 看到的不是浪費,而是有人可能在做值得追的實驗。

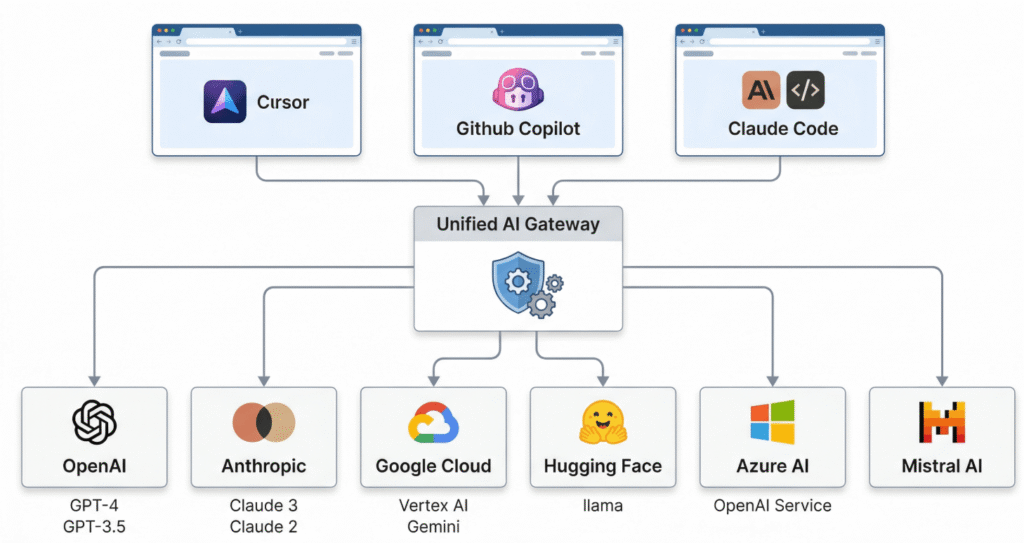

這篇訪談最有用的地方,不是「工程師多快樂地用 AI 寫更多程式」,而是 Shopify 把 AI 導入當成基礎設施題,不是採購題。多數公司還在吵 Cursor、GitHub Copilot、Claude Code 哪個要當標配;Shopify 先把底層收斂,再讓上層混戰。

先標準化底層,不要急著標準化工具

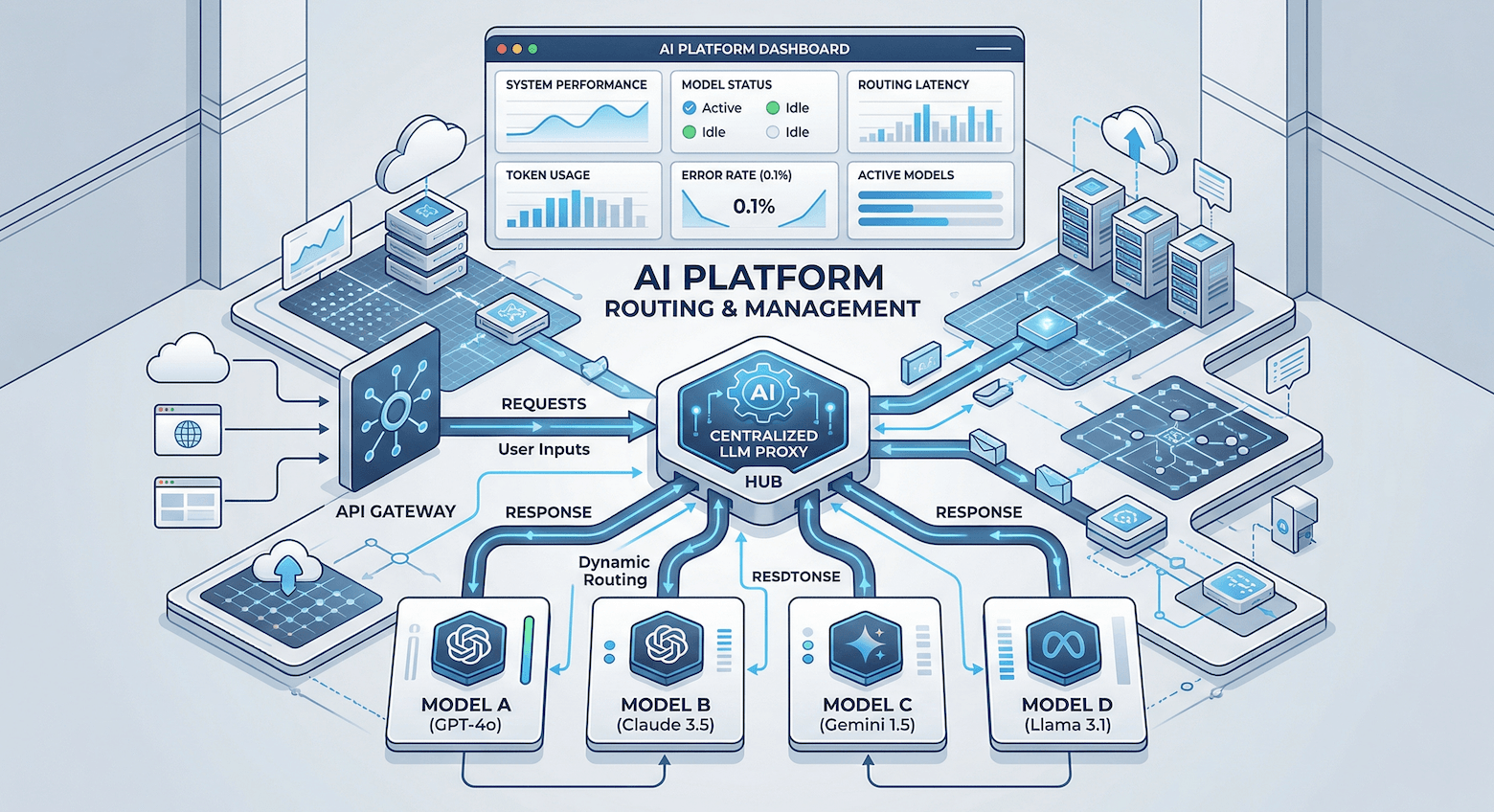

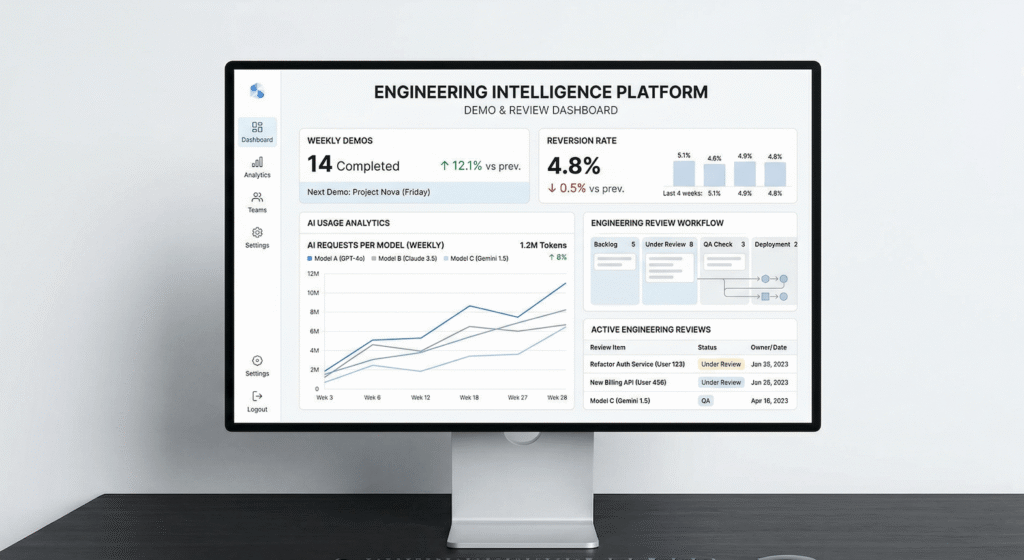

Shopify 的核心做法是建一層 LLM proxy(大型語言模型代理閘道)。所有 AI 請求先過這一層,再轉到 OpenAI、Anthropic 或 Google 的模型。好處很直接:

- 成本集中管理,token 花在哪裡看得到

- 模型可替換,不會被單一供應商綁死

- 工具可並存,Cursor、Claude Code、Copilot 都能試

這個設計很像公司先鋪好 API gateway,再談前端框架選型。AI 工具變化太快,今天統一,明天就過時。底層先穩住,實驗才不會失控。

真正的 KPI 不是程式碼量

Shopify 提到生產力大約增加 20%,但他們沒有拿 lines of code 或 PR 數量當戰功。原因很簡單:AI 最會膨脹這些數字,也最容易把人帶去錯的方向。

他們看的訊號比較務實:每週 demo。團隊有沒有更快做出原型?能不能一次測 10 種解法?卡住的事情有沒有真的被解開?這些比「本週多 merge 幾個 PR」更接近實際產出。

更關鍵的是 guardrail(防護欄)。Shopify 目前不讓 AI 自動把程式碼直接送進 repo,仍然要資深工程師 review。品質則看 reversion rate,也就是 merge 後被回滾的比率。速度可以衝,回滾率不能跟著升。

最大風險不是 bug,是理解力負債

這篇最值得抄的警告叫 comprehension debt(理解力負債)。AI 幫你省掉 toil(重複苦工)沒問題,但如果連理解系統都外包,之後出事你只會更慢。

Shopify 對工程師的要求很硬:你要理解自己工作層以下兩到三層。AI 可以幫你讀 API、測邊界、找漏洞,但不能代替你思考。這也說明了下一步為什麼會走向 agentic workflows(代理式工作流):工程師不再逐行寫,而是指揮多個 agent、審核結果、決定取捨。

對台灣團隊來說,可抄的版本很清楚:先做共用 AI 閘道,再把內部知識系統接進 MCP,最後才談全面推廣。少一點工具宗教,多一點基礎設施紀律,AI 才不會只是公司版玩具。